El seguimiento del movimiento de los ojos es uno de los elementos más importantes en el desarrollo de las tecnologías de realidad virtual y aumentada. En este sentido ponemos el foco en un reciente estudio desarrollado por investigadores de la Universidad RUDN (Rusia) de y cuyos resultados han sido publicados en SID Symposium Digest of Technical Papers.

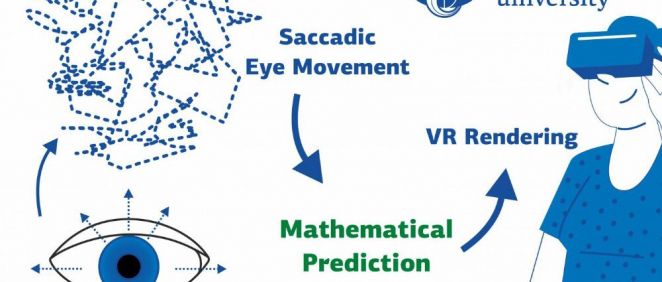

Esta nueva investigación se centra en el desarrollo de un nuevo modelo matemático que ayuda a predecir con precisión el próximo punto de fijación de la mirada, reduciendo de esta forma las inexactitudes derivadas del parpadeo. Este modelo haría que los sistemas de realidad virtual y aumentada fuesen más realistas y sensibles a las acciones del usuario.

El renderizado foveated es una tecnología básica de los sistemas de realidad virtual. Cuando una persona mira algo, su mirada se centra en la llamada región foveada y todo lo demás está cubierto por la visión periférica. Por lo tanto, una computadora tiene que representar las imágenes en la región foveada con el mayor grado de detalle, mientras que otras partes requieren menos potencia de cálculo.

Este enfoque ayuda a mejorar el rendimiento computacional y elimina los problemas causados por la brecha entre las capacidades limitadas de los procesadores gráficos y el aumento de la resolución de la pantalla. Sin embargo, la tecnología de renderizado foveado tiene una velocidad y precisión limitada en la predicción del siguiente punto de fijación de la mirada porque el movimiento de un ojo humano es un proceso complejo y, en gran parte aleatorio.

El rastreador ocular basado en el modelo matemático demostró capacidad a la hora de detectar movimientos oculares menores (3,4 minutos, que es igual a 0,05 grados), y la inexactitud ascendió a 6,7 minutos (0,11 grados)

"Uno de los problemas con la representación foveada es la predicción oportuna del siguiente punto de fijación de la mirada porque la visión es un proceso estocástico complejo. Sugerimos un modelo matemático que predice los cambios en el punto de fijación de la mirada", explica el profesor Viktor Belyaev, Ph.D. en Ciencias Técnicas del Departamento de Mecánica y Mecatrónica de la Universidad RUDN.

Las predicciones del modelo se basan en el estudio de los llamados movimientos sacádicos (movimientos rápidos y rítmicos del ojo). Acompañan los cambios de nuestra mirada de un objeto a otro y pueden sugerir el siguiente punto de fijación. La relación entre la longitud, el alcance y la velocidad máxima de los movimientos sacádicos del ojo está determinada por ciertas regularidades empíricas. Sin embargo, los rastreadores oculares no pueden utilizar estos modelos para predecir los movimientos oculares porque no son lo suficientemente precisos. Por lo tanto, los investigadores se centraron en un modelo matemático que les ayudó a obtener parámetros de movimiento sacádico. Después de eso, estos datos se utilizaron para calcular la región foveada de una imagen.

El nuevo método ha sido probado de forma experimental con un casco de realidad virtual y gafas de realidad aumentada. El rastreador ocular basado en el modelo matemático demostró capacidad a la hora de detectar movimientos oculares menores (3,4 minutos, que es igual a 0,05 grados), y la inexactitud ascendió a 6,7 minutos (0,11 grados). Los investigadores han logrado además suprimir el error de cálculo provocado por el parpadeo: un filtro incluido en el modelo redujo la inexactitud 10 veces. Los resultados del trabajo podrían usarse en modelos de realidad virtual, videojuegos y en medicina para cirugías y diagnósticos de trastornos de la visión.

"Hemos resuelto eficazmente el problema con la tecnología de renderizado foveated que existía en la producción masiva de sistemas de realidad virtual. En el futuro, planeamos calibrar nuestro rastreador ocular para reducir el impacto de los movimientos de la pantalla o del casco contra la cabeza del usuario", concluye el profesor Belyaev.